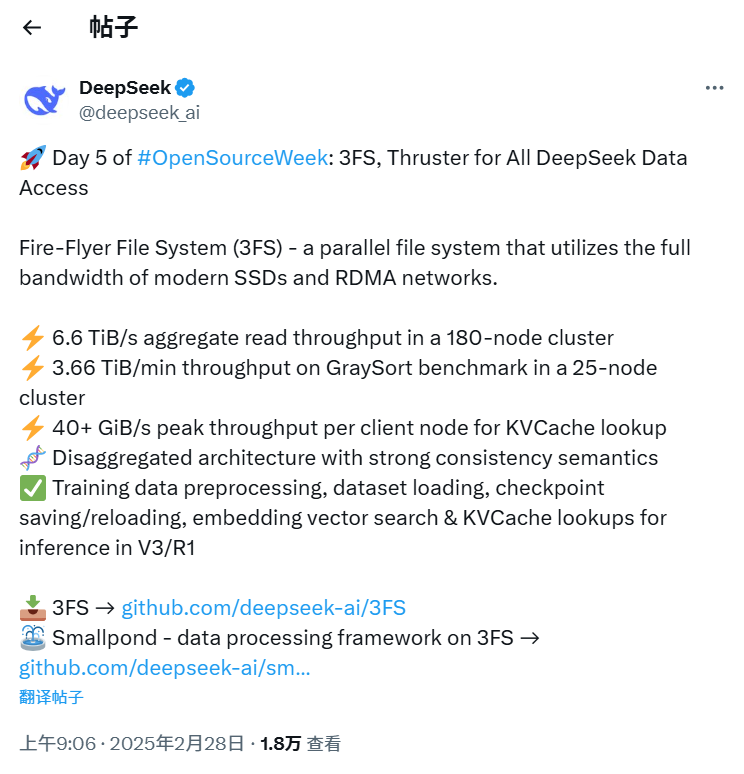

DeepSeek开源Fire-Flyer文件系统(3FS)及Smallpond数据处理框架,提升数据访问效率

2月28日,在“开源周”的第五天,DeepSeek宣布了开源的燃料燃料文件系统(3FS)以及Smplearpond,SmleverPond是一个基于3FS的数据处理框架。

Fire-Flyer文件系统(3FS)是一个并行文件系统,它利用现代SSD和RDMA网络的完整带宽,是所有DeepSeek数据访问的助推器。

它的特征包括:180节点群集中的聚合读吞吐量为6.6Tib/s; 25节点簇中Graysort基准测试的吞吐量为3.66Tib/min;每个客户端节点的峰值KVCache搜索吞吐量超过40GIB/s;具有强烈一致性语义的分解结构;培训数据预处理,数据集加载,检查点保存/重新加载,嵌入式矢量搜索和KVCACHE查询推理在V3/R1中执行。

SmblowPond是一个轻巧的数据处理框架,其特征是其基于DuckDB的高性能数据处理可伸缩性,即无需连续操作而处理PB级数据集的能力以及易于操作。

此时,DeepSeek为期五天的“开源周”活动已正式结束。

2月21日,DeepSeek宣布将从2月24日开放五个代码基础,以完全透明的方式与全球开发人员社区分享他们的研究进度。

2月24日,DeepSeek宣布开源FlashMLA。 FlashMLA是hopper GPU的高效MLA解码核心,并针对可变长度序列进行了优化,现在正在生产中。

2月25日,DeepSeek宣布了开源Deepep,这是第一个用于MOE模型培训和推理的开源EP通信库。

2月26日,DeepSeek宣布了开源DeepGemm。它支持密集布局和两个MOE布局,并且已完全立即编译,这可以为V3/R1模型的培训和推断提供强有力的支持。

2月27日,DeepSeek宣布开源优化的并行性策略。它主要针对大型模型培训中的效率问题。

自今年年初以来,DeepSeek一直很热。 QuestMobile的数据显示,自2月9日启动以来,DeepSeek应用程序的累积下载量超过1.1亿次,每周的活跃用户数量最多,范围为9700万。

最近,据报道,最初计划于今年5月发布的DeepSeek-R2模型以加速的速度开发,并且可能会提前发布。新模型有望在英语以外的其他语言中生成更好的代码和理由。作为回应,DeepSeek的母公司Huanfang定量回应说,官方新闻将占上风。

印度技术服务提供商Zensar的首席运营官认为,DeepSeek-R2模型的发布可能会成为AI行业的关键时刻。 DeepSeek成功地创建了一种具有成本效益的AI模型,这将促使全球公司加速研发流程并打破当前的少数公司的垄断模式。

目前,Openai,Google,XAI,Anthropic,Allibaba和其他人依次启动了新的深入推理/深思熟虑模型。据传,Bytedance的AI Assistan Doubao正在小范围内测试深思熟虑模型的不同实验版本,而DeepSeek模型没有连接。

发表评论

◎欢迎参与讨论,请在这里发表您的看法、交流您的观点。