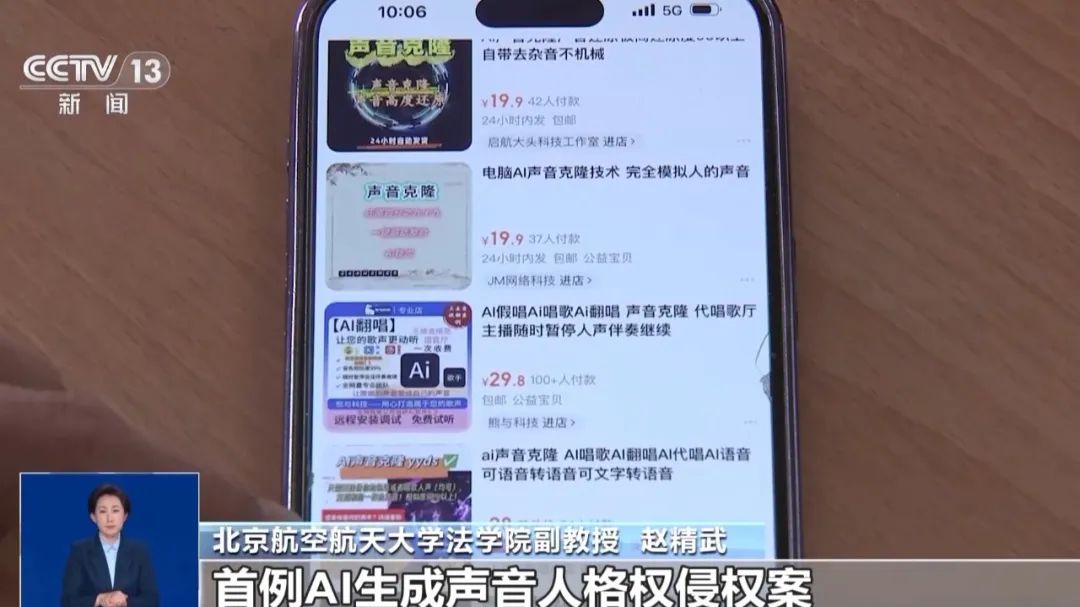

北京首例AI声音侵权案宣判,赵精武解读人格权保护新趋势

不仅名人,而且是普通人甚至动画图像,如果他们在未经该人或版权所有者的同意的情况下使用AI来合成和创建音频和视频,也可以判断为侵权,并承担法律责任。

现代版本的“彩绘皮肤”:AI面向改变会产生“爱骗局”

去年10月,香港警方说,他们已经摧毁了欺诈书。诈骗者使用深层假技术将面孔换成年轻女性,诱使受害者投资虚拟货币产品,其中涉及的金额超过了3.6亿港元。

联合国毒品和犯罪办公室(UNODC)在一份142页的报告中发布了严厉的警告,该报告称,东南亚的欺诈者正在使用生成的AI和深层假技术来扩大骗局操作的规模和有效性。该报告提供了迄今为止最明确的证据,例如去年亚太地区的深层伪造事件增加了1,530%;在过去六个月中,监视数据表明,通过黑暗网络电报的欺诈团伙的深层伪造产品的增加增加了600%以上。

在国内社区的讨论中,许多人已经表示,他们遇到了“潘”和“姐妹潘”,他们主动招募了视频。过去,他们只能播放预先录制的视频,并且无法进行正常的对话。现在他们可以匹配自己的嘴形状和声音。

Guotou Intellignent的首席科学家兼福建省级数据存储和证据援助的主要主要实验室主任Jiang Hanxiang分析了21世纪的商业先驱记者,确实相对容易使用AI视频来更改面孔,而且很难区分真实和错误。

专家:可以使用AI检测AI

随着相关技术的普及,我们应该如何防止侵犯AI-IN-IN-IN-IN-IN-IN-IN-IN-IN-IN-INTHENS合成音频和视频?

中国网络空间安全协会人工智能安全治理专业委员会的专家Xue Zhihui指出,从技术角度来看,AI技术可用于对抗和检测AI。当前,有一些典型的AI技术可以检测这些图片或音频和视频,以确定或分析这些图片是否以后进行处理和合成。

南方金融和经济学的一名记者采访了中国网络空间安全协会人工智能安全治理专业委员会的成员张博,也是天智毒素技术集团的助理主席。张博说,通过例行程序有“三个技巧”:

首先是提高自己对安全风险的认识。 “ AI脸交换”可能与交易欺诈场景结合使用。因此,当涉及诸如提供个人信息,转移和汇款之类的敏感情况时,您应该高度警惕以防止被欺骗。

其次,在接收视频信息(例如视频通话)时,您应该仔细观察另一方视频中的光背景,面轮廓和其他细节是否很自然。如有必要,您可以要求对方快速抬起,降低头,向左和向右转。观察图片中是否存在任何异常,并进一步验证视频的真实性。

第三,当面对诸如转让和汇款之类的金融交易时,您可以通过其他相对可靠的方法(例如亲自拨打电话)确认另一方的身份,以确保交易信息正确并避免因信任虚假而造成的损失信息。

中国计算机协会计算机安全专业委员会成员卢扬伊(Lu Yanhui)表示,防止AI侵权需要从法律,平台和公众等多个层面中采取的全面措施。在法律层面上,有必要进一步改善相关立法,完善AI克隆技术的法律规定,阐明侵权的定义和责任,并加强执法。在平台层面上,我们必须加强相关政策和法规的宣传和实施,在保护现有数据方面做得很好,并使用技术手段避免出现AI克隆侵权问题。同时,我们必须建立并改善内容审查和侵权报告机制,并迅速发现和处理它们。侵权问题。

法律专家还提醒AI深入的合成生产和信息出版商不幸运。法律没有灰色区域,也不会因为小而失去大局。

Zhao Jingwu强调,法律并不禁止使用AI合成技术,而是禁止使用非法和不合理的使用,尤其是禁止在没有任何明显识别和提示的情况下释放和传播AI合成信息。

发表评论

◎欢迎参与讨论,请在这里发表您的看法、交流您的观点。